通过 API 使用

让应用直接通过 API 调用同一个 cloud skill,而不用围绕它再补一层独立后端。

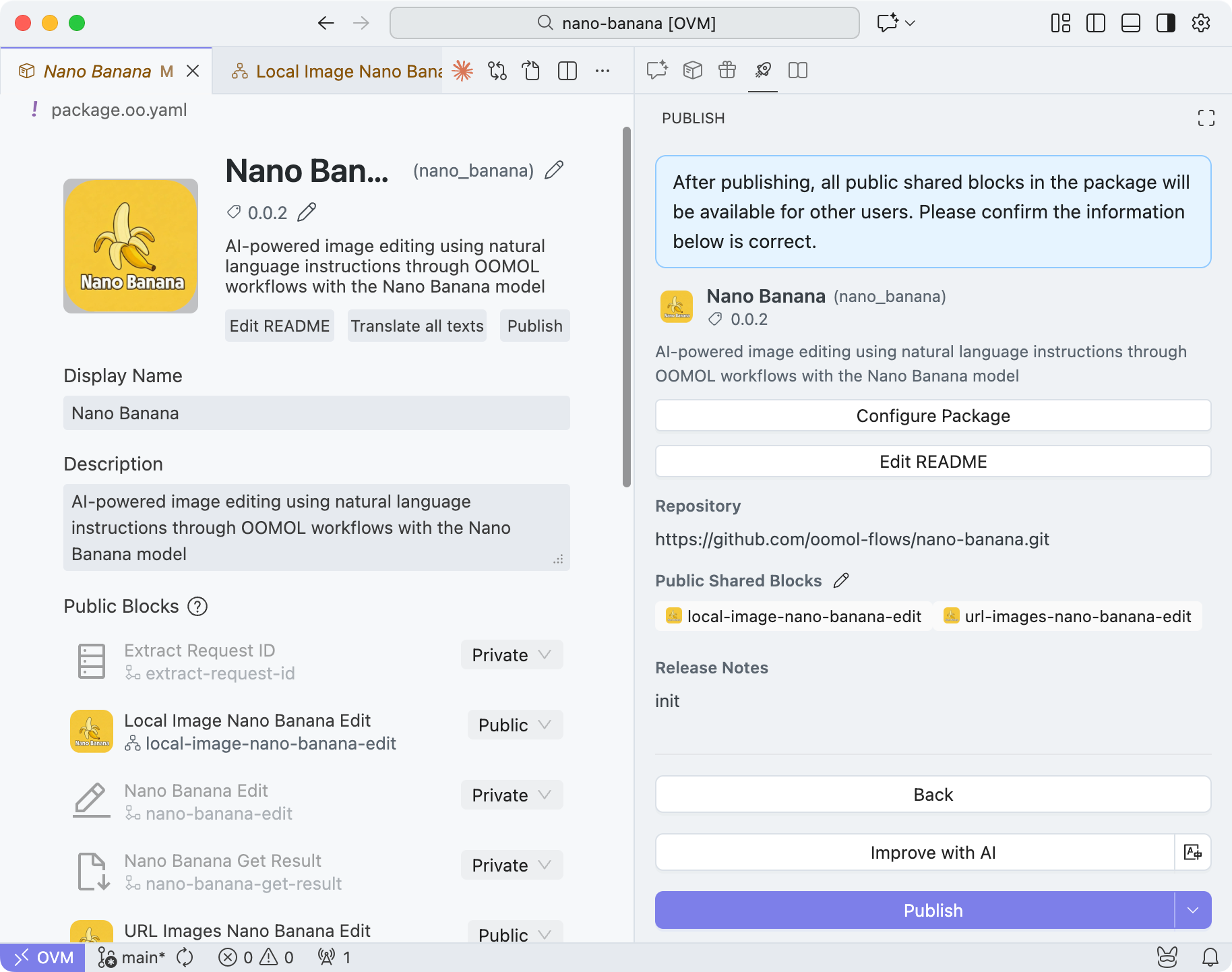

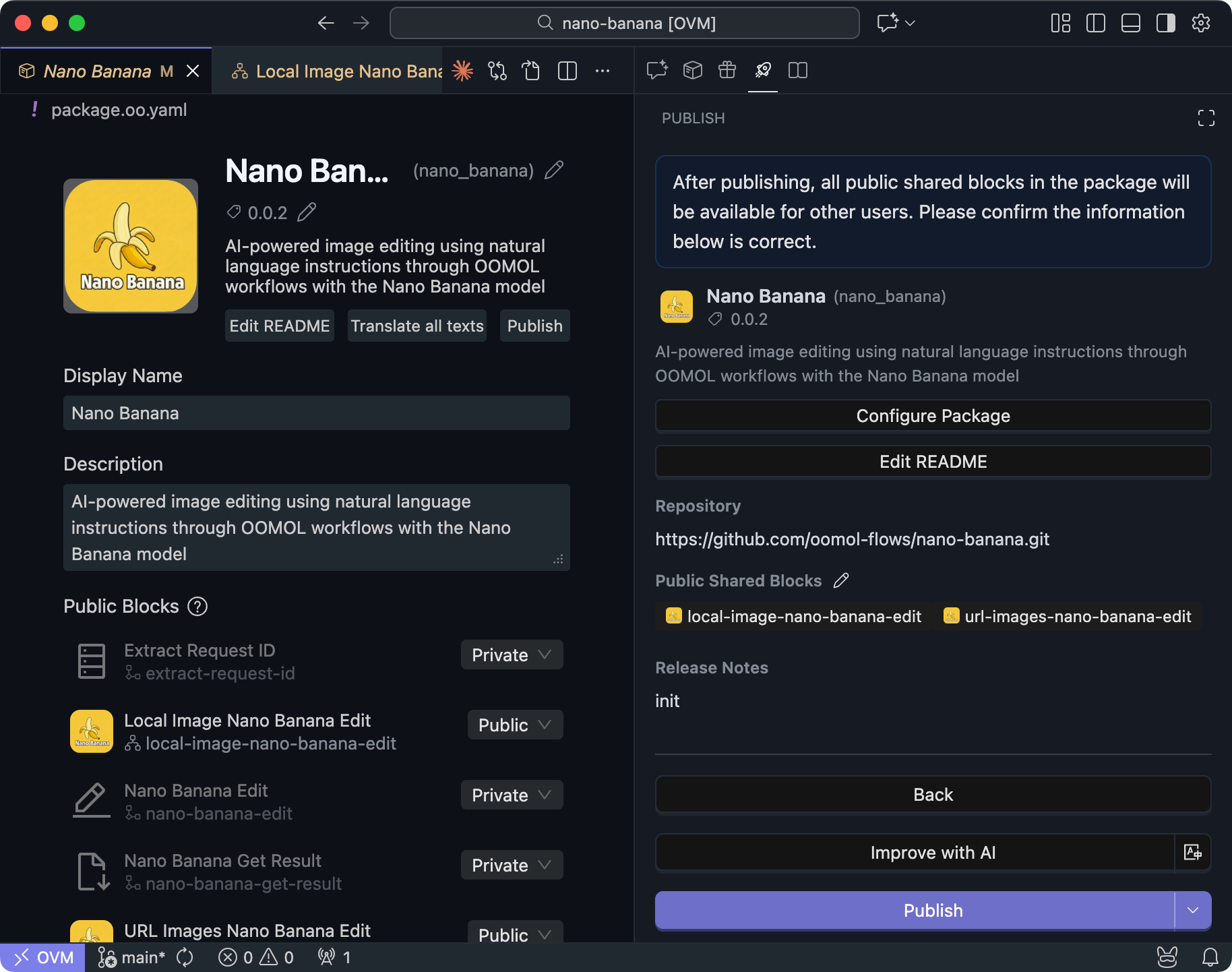

把已经在本地验证过的 skill 放到云端运行,让用户用到能力,而不用拿到你的源码或一套单独搭出来的服务。

用户通过 oo-cli、应用或 agent 使用 skill,而你的实现继续留在服务器端。

真正拖慢交付的,往往不是 skill 本身,而是围绕它补出来的那层东西:给用户做入口、让它稳定在线、控制访问、承担运维。Cloud 的目标就是把这一层压到最短。

同一个 cloud skill 可以继续通过 API、MCP 或自动化被消费,同时仍然只维护一份实现。

让应用直接通过 API 调用同一个 cloud skill,而不用围绕它再补一层独立后端。

当 agent-native 集成更重要时,把同一个 cloud skill 作为 MCP Tool 暴露给 Agent 和 AI 应用。

让同一个 cloud skill 按触发器或定时器持续运行,而不是只停留在本地手动执行。

即使你发布的 cloud skill 是私有的,底层运行时基础仍然保持开源。

OOMOL 的虚拟机和运行时核心持续开源,所以无论你用个人服务器、私有基础设施还是公有云,都依然保有部署自由,同时为每个 skill 单独决定如何交付。

跨平台虚拟机管理器,为 OOMOL 提供统一的容器运行环境

OVM 的核心运行时库,处理容器生命周期和资源管理

Windows 平台的 OVM 实现,支持 WSL2 和 Hyper-V

macOS 平台的 OVM 实现,基于 Apple Virtualization Framework

OOMOL Cloud 不只是代码运行的地方,而是把已经验证过的实现变成 cloud skill,并私有交付给自己、团队或客户的那一层。